尽管对许多行业来说,ChatGPT 证明了自己是一个白日梦工具,但它正迅速成为学术界的噩梦。

截至 2023 年 1 月,四篇不同的研究论文在研究项目中将该人工智能聊天机器人列为共同作者——这迫使科学期刊争相更新其政策和规定,以解决可能出现的伦理问题。

猫咪作者的伦理问题

将对科学论文贡献甚微甚至毫无贡献的作者添加进去的过程称为荣誉作者,并且在过去曾引起一些严重的伦理问题。最早的此类问题之一发生在 20 世纪 70 年代中期,令人惊讶的是,涉及一只猫。

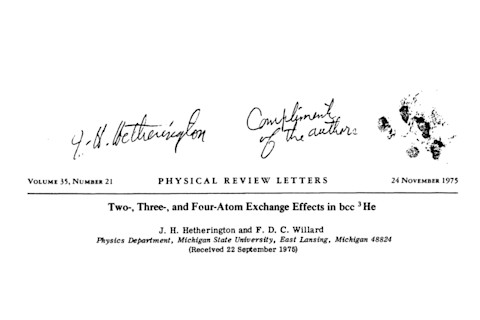

1975 年,密歇根大学的一位名叫杰克·赫瑟灵顿(Jack Hetherington)的物理学教授刚刚写完一篇关于粒子在不同温度下行为变化的影响深远的论文。该论文即将发表在《物理评论快报》上,截止日期临近。

不幸的是,一位同事指出了一个问题:赫瑟灵顿在论文中使用了“我们”来指代自己,但他是唯一的作者,这可能会导致论文被拒。

因此,赫瑟灵顿没有重新排版整篇论文,而是直接将他的暹罗猫切斯特(Chester)的名字添加为共同作者。

(图片来源:Jack Hetherington 博士,《科学中的更多随机游走》,约 1975 年。)

Jack Hetherington 博士,《科学中的更多随机游走》,约 1975 年。

在 R.L. Weber 的文集《科学中的更多随机游走》中,赫瑟灵顿解释说,他为切斯特创造的笔名 F.D.C. Willard 是将“猫”(Felix domesticus,家猫的拉丁语名称)放在切斯特名字的首字母前,然后将切斯特父亲的名字 Willard 作为姓氏。

阅读更多:人工智能的利弊

猫咪的秘密

“我并没有完全忽视宣传价值,”赫瑟灵顿在他的书中承认。“如果最终证明是正确的,人们会因为知道不寻常的作者身份而更多地记住这篇论文。”

赫瑟灵顿的理论被证明是正确的。这篇论文不仅被广泛引用,而且世界最终也知道了切斯特的作者身份——引起了更多的关注。

虽然密歇根大学利用了这一关注,甚至为切斯特提供了一个“杰出访问研究员”的教职,但其他人却不那么高兴。《物理评论快报》的编辑们认为,发表一篇由猫共同撰写的论文让他们感到被误导和愚蠢。

然而,当时的伦理争议在很大程度上被忽视了,切斯特在 1982 年去世(享年 14 岁)之前,又共同撰写了两篇论文和一篇独立论文。他的Google 学术资料显示,他的论文被引用了约 104 次。

为了纪念切斯特的贡献,2014 年 4 月 1 日,美国物理学会宣布了一项针对所有猫咪作者论文的开放获取倡议。

阅读更多:五只属于著名科学家的猫

宠物作者

切斯特的故事只是科学家将宠物或动物实验对象列为共同作者的少数案例之一。

诺贝尔奖得主安德烈·盖姆(Andre Geim)与一位署名“H.A.M.S. ter Trisha”的作者共同撰写了一篇论文(并非他的诺贝尔获奖论文)。尽管该论文未披露 Trisha 的贡献,但盖姆仍成功地将他的宠物仓鼠添加为荣誉作者。

其他人则没那么幸运。免疫学家波莉·马辛格(Polly Matzinger)于 1978 年在《实验免疫学杂志》上与她的狗 Galadriel Mirkwood 共同发表了一篇将狗列为荣誉作者的论文。

在得知真相后,该期刊的编辑禁止马辛格发表论文,直到该编辑去世为止。她还成为了加州大学圣地亚哥分校内部调查的对象。

幸运的是,马辛格能够证明她的狗确实为她的研究做出了贡献,并且没有欺诈行为。

尽管这个例子表明动物实验对象比普通的宠物更有权被列为论文的共同作者,但维尔茨堡大学的汉斯鲁迪·伦茨(Hansrudi Lenz)认为这种做法是不道德的。

“合乎逻辑的是,宠物或已故的亲属无法对科学出版物做出真实且可识别的贡献,”他说。

阅读更多:狗和它们的主人拥有相似的性格特征

荣誉作者

这些故事的奇思妙想很容易掩盖它们引起的伦理困境,但荣誉作者的做法——即使是超出宠物范围——由于科学家们感到持续发表的压力而继续存在。

在一项 2020 年的研究中,波兰西里西亚大学的 Mariola Paruzel-Czachura 和她的团队发现,最常见的科学不端行为报告形式是荣誉作者,52% 的研究参与者观察到了这种做法。

“这可能是一种贿赂,”Parazel-Czachura 说,并提出了如此高比例的一个可能原因。“这可以帮助研究人员获得更好的工作,或为会议争取资金。它甚至可以是一种合作,双方研究人员同意互相添加对方为荣誉作者。”

然而,这会导致作者数量膨胀的问题,即作者的引用次数高于实际应有的次数,因为他们似乎“发表”了更多的论文。

阅读更多:古代人类真的像我们一样养宠物吗?

AI 作者

现在,随着信息时代的到来及其带来的所有事物(指的是 ChatGPT),研究人员进行荣誉共同作者的做法变得更加容易。因此,大多数学术期刊发现,监管 AI 共同作者变得更加困难。

“我们正试图采取最谨慎的方法,”《科学》杂志的总编辑 H. Holden Thorp 说。“我们会从更严格的规定开始,然后随着时间的推移放宽。”

在 2023 年 1 月的《科学》社论中,Thorp 引用了几项此类政策变更——包括完全禁止使用 ChatGPT 或其他 AI 工具生成的任何部分文本、图像、图表或图形。

Thorp 与其他人一样,希望国家科学院能够尽快解决这个问题,以确立处理 AI 荣誉作者的先例。

事实上,前进的道路可能在于德国科隆大学的研究人员在 2017 年发表的一篇论文。他们写道:“在科学出版物中考虑[他人]事实作用的适当方式通常应在致谢部分。”

作者们随后在这部分感谢了他们的金鱼爱因斯坦和海森堡。

阅读更多:人工智能与人脑:有多相似?