普渡大学的研究人员表示,触摸屏的下一步可能是摆脱实际屏幕。工程师 Karthik Ramani 和 Niklas Elmqvist 及其同事最近推出了一种基于投影仪的计算机输入系统,该系统可以将桌子、办公室墙壁,甚至厨房岛变成交互式表面。

该系统名为扩展多点触控,由计算机、投影仪和 Microsoft Kinect 深度感应摄像头组成。(Kinect 也用于 Xbox 360,它使用户能够在不接触任何东西的情况下通过光学方式与游戏和设备交互。)投影仪将典型计算机屏幕的内容显示到冰箱或石制台面等表面上,而 Kinect 的红外激光和接收器估计到表面的距离。

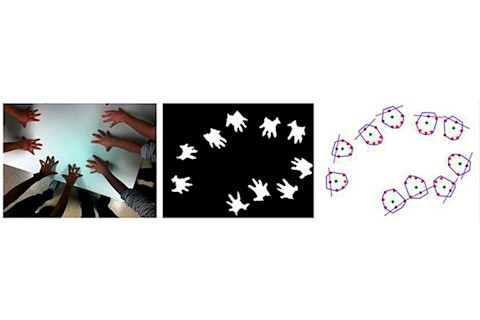

使用扩展多点触控系统,任何表面都可以变成触摸屏。它可以破译几只手,(左侧)将它们形状转换为计算机图像(中间)和每只手的触摸点映射(右侧)。| C-Design 实验室/普渡大学

当用户将手移入视野时,Kinect 以每秒 30 帧的速度捕捉图像,计算机中的图像处理算法会跟踪并破译帧与帧之间的变化。“基本上,我们知道你的手在哪里以及你的手在做什么,”Ramani 说。如果用户的手指距离投影图像(即表面)几厘米以内,系统就会将其解释为触摸。

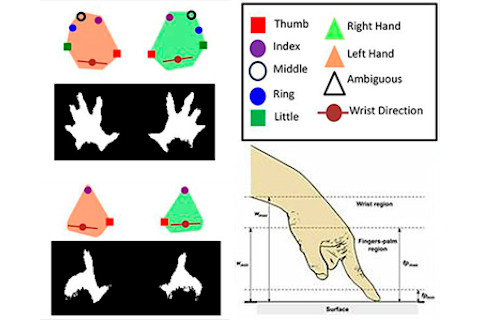

其他研究人员已经展示了可以使用类似虚拟点击的技术,但普渡大学的系统是独一无二的:它可以区分拇指和手指,区分左手和右手,甚至可以同时跟踪多个用户的手。在一个实验中,几名受试者在桌子上绘制虚拟图片,计算机以独特的颜色标记每个人的渲染。

手的触摸点基于手的姿势的计算机快照。| C-Design 实验室/普渡大学

扩展多点触控系统可以捕捉 16 种不同的手势,这些手势可以被转换为更复杂的命令——相当于在触手可及的范围内有一个带有 16 个按钮的鼠标。Elmqvist 设想工程师和建筑师仅用双手设计虚拟 3D 结构——无需鼠标点击或键盘敲击。

消费者也可以从这项技术中受益,将几乎任何表面变成巨大的 iPad;厨房桌上的虚拟空气曲棍球游戏可以被擦除以阅读互动版报纸或 Pinterest 上的食谱。“我们正在经历一场人类与物理和虚拟事物交互的革命,”Ramani 说。“我看到了一个崭新的世界正在出现。”