本文刊登于 2020 年 6 月刊,标题为“人工智能会让医疗更人性化吗?” 订阅《探索》杂志,获取更多此类故事。订阅《探索》杂志,阅读更多此类文章。

如今,看医生有时会让人感觉有些疏远;对许多人来说,医生显得匆忙、冷漠且疏远。根据《综合内科杂志》2019 年的一项研究,医生只在约三分之一的时间里询问患者的担忧。即使询问,他们也常常在 11 秒内打断患者。而且,由于医生现在必须将医疗数据录入电子健康记录,他们常常在看诊时低头操作电脑键盘,而不是与患者交流。这些短暂、尴尬的就诊可能会带来严重后果:2014 年的一项研究估计,美国每年约有 1200 万成年人被误诊。

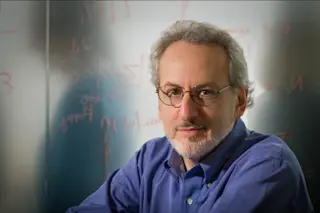

然而,有些矛盾的是,心脏病专家 Eric Topol 认为,机器——尤其是人工智能——或许能提供帮助。

Topol 还是 Scripps Research Translational Institute 的创始人兼主任,他长期以来一直倡导医学与技术的结合。近年来,他一直在研究传感器、影像、远程医疗和其他技术如何能引领医学领域的新数字革命,以及患者有一天如何能够生成并拥有自己的医疗数据。在他的最新著作《深度医学:人工智能如何让医疗保健重拾人性》中,Topol 提出,人工智能可以通过让医生有更多时间与患者互动来改善医疗保健。

人工智能已经在医学领域掀起了波澜。研究人员已经开发出算法,可以从胸部 X 光片中识别肺炎,从 MRI 扫描中评估心脏病风险,甚至预测哪些皮肤病变可能癌变。但 Topol 认为,机器还可以承担更琐碎的任务,例如做笔记,从而让医生有更多时间与患者相处。《探索》杂志最近采访了 Topol,探讨了医患关系、人工智能的潜在陷阱以及他称之为“通过使用机器来改善医学人性化方面这一反直觉的故事”的其他方面。

问:作为一名心脏病专家行医 35 年后,是什么促使您从患者护理转向研究和数字医学?

答:嗯,我并没有完全 [转变],因为我仍然会看病人——我今天就在诊所。我基本上只是把更多的精力投入到研究方面,但我从来不想放弃临床、患者护理部分。因为这一切的核心就在于此,不是吗?我参与的所有研究都与患者有着某种联系,以努力改善医学。

问:为什么医患之间的这种联系如此重要?

答:今天在诊所,我正在完成与一位我合作了两年多的 [医学] 研究员的会谈。他的一个优点是能够与我们的患者建立联系。今天有一位病人因为他要调动工作、结束进修而哭泣。对我来说,这才是医学的本质。人们倾向于认为我非常高科技,热衷于各种小玩意、传感器和人工智能。但自从我 [自己] 生病以来,我对此类关系有了更深的体会。没有它,医学就毫无意义。

问:您最近谈到如今的医学缺乏人际互动。例如,您指出电子健康记录基本上将医生变成了数据技术员。我们是如何走到这一步的?

答:最大的罪过是让医学变成了一个大生意。电子健康记录是现代医学最糟糕、最彻底的失败,因为它只是为了商业目的——为了计费——而设立的,完全没有考虑对医生、患者或任何其他临床医生的益处。这是其中一个主要原因。

另一个原因是行政人员的无序增长,其比例与实际照顾患者的人员之比大约为 10:1。所有这一切都是为了提高生产力。不幸的是,几十年来,医学已经迷失了方向。

问:在当今的医疗体系中,患者有任何发言权吗,还是技术总是损害他们的利益?

答:这里存在一种张力,因为有些事情在促进 [患者] 的赋权,比如生成自己数据的能力。一个例子是 Apple Watch,它可以检测到异常的心律。或者,在英国,你可以用人工智能工具诊断尿路感染。或者你可以通过智能手机诊断孩子的耳部感染,而无需医生。而且,[很快将有可能通过一张图片和一个算法来诊断] 皮肤上的病变、皮疹或癌症。有很多不同的方式可以实现 [患者] 赋权。而且这是无医生介入的,通过传感器和摄像头进行算法解读,准确无误——无需与医生联系。

但与此同时,我们仍然存在数据访问稀疏以及个人对自己应享有合法所有权 [的医疗数据] 的控制权不足的问题。

问:让我们来谈谈患者数据。某些类型的人工智能,例如解释影像扫描的机器学习算法,是在幕后进行的,对患者来说完全是不可见的。他们应该知道他们的数据何时以及如何被使用吗?

答:人工智能已经以多种方式渗透到人们的生活中——无论是歌曲推荐、亚马逊购物还是自动纠错的词语。所有这些事情都在发生。因此,这种算法的不可见性已经嵌入我们的生活中。自动纠错是一回事;医疗问题又是另一回事。我认为我们需要退一步,区分正常的、日常生活中不构成严重问题的事务,以及将成为一个人医疗诊断和治疗一部分的算法。

问:您对医疗保健(包括人工智能)中的种族偏见有多担忧?例如,2019 年《科学》杂志的一项研究发现,一个广泛使用的算法存在种族偏见。该算法旨在根据患者以往的“护理成本”或过去的医疗费用来帮助医院预测哪些患者可能受益于额外的治疗。但它却对病情更严重的黑人患者和病情较轻的白人患者赋予了相同的“风险”水平。人工智能如何产生偏见?

答:算法本身没有偏见;这是因为将数据输入其中的人类。这里的巨大错误是 [开发者] 假设,如果数据库中的护理成本较低,就意味着更健康。但事实并非如此,它可能意味着你根本无法获得护理。结果,当 [研究人员] 查看数据时,他们意识到许多护理成本低的人是黑人,他们根本没有或很少获得护理。这与算法无关。我们拥有的是人类的偏见,然后我们将其归咎于机器。

问:精神疾病呢——人工智能能在这方面提供帮助吗?

答:这是我们最激动人心的新方向之一。因为精神健康问题,尤其是抑郁症,但普遍而言,它们都非常重要。在合格的咨询师、心理学家、精神科医生和普遍的精神健康专业人士方面,它们也人员不足。因此,能够实时量化一个人的精神状态是一项非凡的新发展。无论是因为你的键盘敲击方式、你的语音语调、你的呼吸,还是所有其他可以被动评估的参数,无需任何努力。有很多不同的方法可以捕捉这些数据。现在,我们可以量化这些。我们以前从未能做到这一点——以前一切都是主观的,比如,“你感觉情绪低落吗?”

另一个 [发展] 是人们意识到与 [人工智能] 化身交谈是完全自在的。他们不必与真人交谈。事实上,他们宁愿向化身倾诉他们内心深处的秘密。对我来说,这仍然令人震惊,但已经通过多项研究得到了证实。

尽管人工智能在精神健康领域的应用仍处于非常不发达和早期阶段,但它是未来最大的机遇之一。因为精神健康负担与该领域支持人们的能力之间存在巨大的不匹配。我认为这里的潜力非常非凡。它利用技术来改善人类的精神健康,而这方面的尊重程度往往不如身体健康。

问:您如何调和您对人工智能的乐观态度与其阴暗面,如监视和数据被黑客攻击的可能性?

答:好吧,我是一个乐观的人;我一直都是。我妻子总是为此取笑我。……[但是] 我知道事情会出错——从对算法的恶意攻击,到我们都非常熟悉的普通软件故障。以及加剧不平等的偏见。所有这些颠覆性的、反乌托邦式的担忧。

意识到这一点是故事的一部分。有趣的是,人工智能可以使事情整体变得更好或更糟。它可以加剧不平等,也可以改善不平等;它可以加剧偏见,也可以改善偏见。无论从哪个角度来看,都可以说它是一把双刃剑。它非常强大,可以使许多事情变得更好或更糟。只有时间会证明一切,而我们确实处于非常早期的阶段。

问:您为何如此热衷于探索人工智能如何能为医疗保健注入人性?

答:我们正处于一种绝望的境地,我们需要承认 [医学] 中缺乏人际联系和同情心。这是医疗保健中“关怀”的缺失。在未来几代人中,我们可能正看向我们最佳的解决方案。从其潜力来看,这比我 35 年来所见过的任何事物都更具吸引力和诱惑力。我老了,见过很多事情,但从未见过这样的。

我确实认为这需要大量的工作和大量的验证。当你拥有如此强大的东西时,如果你做得对,你就可以让医学回到 40 年前的样子——那时,它是一个完全不同的模式。那时,你与医生在一起时,是一种非常紧密、信任的关系。而且你知道,当你生病时,有人在你背后支持你;他真正关心你,有时间给你,并且没有看着电脑屏幕。我们可以找回那个。这令人兴奋。

问:我们距离那个现实还有多远?

答:因为我比较乐观,所以我总是倾向于低估所需的时间。然后我看看我的孙子们,他们分别是 5 岁和 2 岁。我只是希望,现实地说,到他们长大时,医学能够得到恢复。但这需要时间。它也不会一蹴而就。但我希望在接下来的五年里能看到它的开端。广告牌上不再宣传该医疗系统是全国最好的,而是会说:“我们给病人时间。我们给医生和护士与病人相处的时间。” 如果我们开始看到医疗系统在“给予时间”这一方面展开竞争,那将是这场“回到未来”故事的开端。